Die Fibel zu Bluetooth® Low Energy

4.1 Die Bluetooth Kernspezifikation

5.2 Die Schichten im Überblick

6.2.1 Gaußsche Frequenzumtastung

6.5 Sendeleistung und Empfangsempfindlichkeit

6.6.2 Bluetooth Channel Sounding

7.1 Überblick über die Verbindungsschicht

7.6 Überwachung der Inserenten

7.7 Die Datentransportarchitektur

7.8.1 LE ACL - LE Asynchroner verbindungsorientierter logischer Transport

7.8.2 ADVB - LE Advertising Broadcast

7.8.3 PADVB - LE Periodic Advertising Broadcast

7.8.4 PAwR - LE Periodische Werbung mit Antworten

7.8.5 LE BIS und LE CIS - Isochrone Kommunikation

8.1 Einführung in Bluetooth Channel Sounding

8.3 Bluetooth Channel Sounding in der Datentransportarchitektur

8.4 Zwei Bluetooth Channel Sounding Methoden

8.4.2 Hin- und Rückreisezeitpunkt

8.5 Bluetooth Channel Sounding Kontrollverfahren der Verbindungsschicht

8.5.1 Channel Sounding Sicherheit Start

8.5.2 Channel Sounding Austausch von Fähigkeiten

8.5.3 Channel Sounding Konfiguration

8.5.4 Mode-0 FAE-Tabellenabfrage

8.10.3 Kanalwahl und Frequenzsprungverfahren

8.11 Antennenumschaltung und Antennenwege

8.13.3 Bluetooth Channel Sounding Sicherheitseigenschaften

8.14 Anwendungen zur Entfernungsmessung

9. Die isochrone Anpassungsschicht

9.3 Fragmentierung und Rekombination

9.4 Segmentierung und Wiederzusammenbau

10.2 Die HCI-Funktionsspezifikation

10.4.1 Verbindungslose AoA/AoD

10.4.2 LE-Pfadverlust-Überwachung

11. Das Logical Link Control and Adaptation Protocol

11.2 L2CAP und Protokoll-Multiplexing

11.4 L2CAP-Segmentierung und Neuzusammensetzung

12.2.4 Hinweise und Bestätigungen

12.2.6 Maximale Übertragungseinheit

12.5 Entdeckung der Unterstützung für EATT

13. Das generische Attributprofil

13.2 Bluetooth SIG vs. Benutzerdefiniert

13.4.1 Bluetooth SIG nur definierte Attribute

13.4.2 Mischung aus Bluetooth SIG und benutzerdefinierten Attributen

14. Das allgemeine Zugangsprofil

14.5 Gerichtet und ungerichtet

14.6 Durchsuchbar vs. nicht durchsuchbar

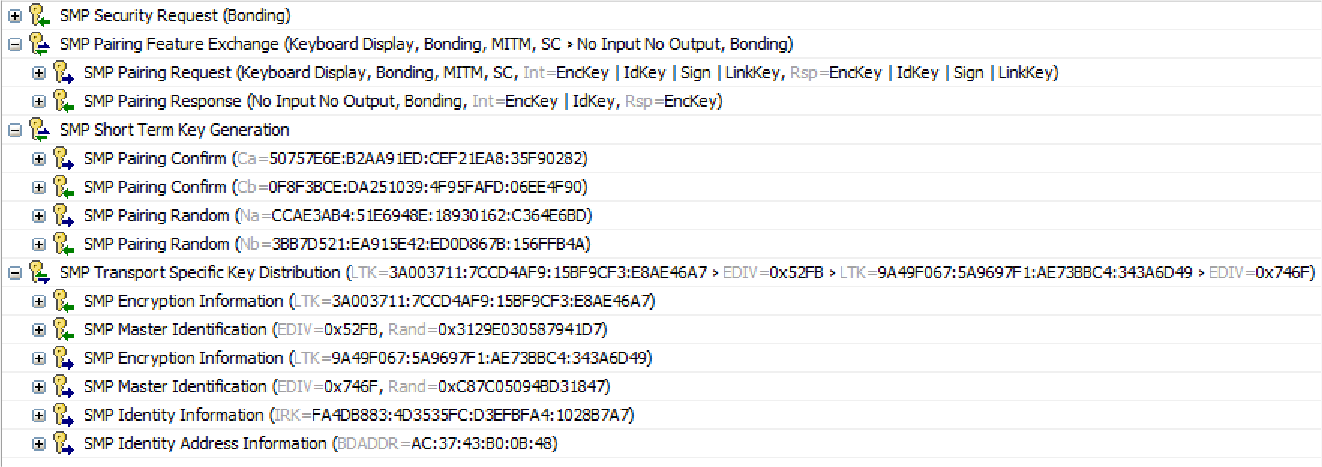

15. Das Sicherheitsmanager-Protokoll

1. Revision Geschichte

| Version | Datum | Autor | Änderungen |

|---|---|---|---|

| 1.0.0 | 22. April 2022 | Martin Woolley, Bluetooth SIG | Ursprüngliche Version. |

| 1.0.4 | 6. Juni 2022 | Martin Woolley, Bluetooth SIG | Verbesserungen im Abschnitt Link Layer: Hinzufügung der Information, dass mehrere Link Layer State Machine Instanzen erlaubt sind, Verbesserung der Sprache, um sicherzustellen, dass es sich bei der Kanalklassifizierung um ein optionales Implementierungsmerkmal handelt, Unterscheidung zwischen Kanalstatusberichten und Kanalplanaktualisierungen und Hinweis darauf, dass AFH in einem regulatorischen Kontext eine andere Bedeutung haben kann. |

| 1.1.0 | 17. Januar 2023 | Martin Woolley, Bluetooth SIG | Aktualisiert, um die Bluetooth® Core Specification 5.4 widerzuspiegeln und Informationen über periodische Werbung mit Antworten hinzuzufügen. |

| 1.2.0 | 15. März 2024 | Ifti Anees, Bluetooth SIG | Formataktualisierungen und Korrektur von 14.2 Tippfehlern im Zusammenhang mit der Beobachterrolle. |

| 1.3.0 | 15. Oktober 2024 | Martin Woolley, Bluetooth SIG | Aktualisiert, um Informationen über die Funktionen Bluetooth® Channel Sounding, Decision Based Advertising Filtering und Monitoring Advertisers sowie die überarbeiteten zulässigen Werte der Inter-Frame-Space-Timing-Variablen aufzunehmen. |

2. Über dieses Papier

Der Bluetooth® Low Energy Primer wurde erstellt, um Technologieexperten wie Produktdesignern und -entwicklern zu helfen, sich schnell mit Bluetooth Low Energy (LE) vertraut zu machen, bevor sie die offiziellen technischen Spezifikationen konsultieren und tiefer in das Thema einsteigen.

Bei der Bluetooth SIG gibt es eine umfangreiche Sammlung von Spezifikationen, Papieren und anderen Bildungsressourcen zu Bluetooth LE . Ein weiteres Ziel dieses Papiers ist es, das Bewusstsein für ihre Existenz und ihren Zweck zu schärfen und dem Leser zu helfen, sich mit dem Thema und dem dazugehörigen Material zurechtzufinden.

Die meisten Bluetooth LE verwenden entweder eine Kombination aus verbindungsloser Kommunikation(Werbung) und Punkt-zu-Punkt-Verbindungen, um Daten auszutauschen, oder sie kommunizieren nur über das Senden von Werbepaketen. Diese Ressource behandelt den Bluetooth LE , wie er für Produkte verwendet wird, die in diese Kategorien fallen. Im Gegensatz dazu wird Bluetooth Mesh hier nicht behandelt. Bluetooth Mesh ist eine spezielle Anwendung von Bluetooth LE , zu der andere Informationsquellen konsultiert werden sollten.

Es ist nicht das Ziel dieses Papiers, genau dasselbe Terrain wie die formalen Spezifikationen zu reproduzieren oder in derselben Tiefe zu behandeln. Von Zeit zu Zeit können kurze Auszüge aus den Spezifikationen eingefügt werden, wenn dies sinnvoll ist. Sie sollten dieses Papier als Orientierungshilfe betrachten, indem es wichtige Bluetooth LE Konzepte vorstellt und erklärt, den Weg zu anderen Ressourcen und Spezifikationen weist und hoffentlich die Lernkurve ein wenig weniger steil macht.

3. Einführung

Die Bluetooth-Technologie gibt es seit dem Jahr 2000. Ursprünglich wurde sie entwickelt, um den drahtlosen Datenaustausch zwischen zwei Geräten zu ermöglichen, ohne dass weitere Netzwerkgeräte erforderlich sind, und fand schnell Eingang in Produkte wie drahtlose Mäuse und Freisprecheinrichtungen für Autos. Letztere ist ein Audioprodukt, und Audio erwies sich als die "Killer-App" für diese ursprüngliche Version der Bluetooth-Technologie. Das war auch viele Jahre lang so.

Diese erste Version der Bluetooth Technologie, die in den allerersten Bluetooth Produkten verwendet wurde, ist offiziell als Bluetooth BR (Basic Rate) bekannt. Sie bot eine Rohdatenrate auf der physikalischen Schicht von 1 Million Bits pro Sekunde (1 mb/s).

Später wurde eine schnellere Version der Bluetooth-Technologie mit der Bezeichnung Bluetooth BR/EDR (Enhanced Data Rate) definiert. Sie bot eine Rohdatenrate von 2 mb/s, war aber immer noch für Anwendungsfälle gedacht, bei denen zwei Geräte direkt miteinander Daten austauschen.

Bluetooth Low Energy (LE) wurde erstmals in der Version 4.0 der Bluetooth Core Specification[1] vorgestellt. Dabei handelte es sich um eine neue Version der Bluetooth-Technologie, die ihren Vorgänger Bluetooth BR/EDR nicht ersetzte, sondern als Alternative mit Fähigkeiten und Qualitäten, die sie perfekt für eine neue Generation von Produkten und die Erfüllung neuer und anspruchsvoller technischer und funktionaler Anforderungen machten.

Bluetooth LE unterstützt andere Topologien als die Punkt-zu-Punkt-Kommunikation zwischen zwei Geräten mit einer Vielzahl von Broadcast-basierten Modi, die es einem Gerät ermöglichen, Daten an eine unbegrenzte Anzahl von Empfängern gleichzeitig zu übertragen. Es ist auch die Grundlage für Bluetooth-Mesh-Networking, das den Aufbau von Netzwerken mit Zehntausenden von Geräten ermöglicht, von denen jedes mit jedem anderen Gerät im Netzwerk kommunizieren kann.

Die Eins-zu-Eins-Kommunikation zwischen zwei Geräten wird sowohl durch die verbindungsorientierte als auch durch die verbindungslose Kommunikation unterstützt. Die Eins-zu-Viele-Kommunikation wird durch verbindungsloses Broadcasting unterstützt.

Die Richtung, in die Anwendungsdaten übertragen werden können, hängt von der Art und Weise ab, in der Bluetooth LE verwendet wird. Beachten Sie, dass der Begriff Modus hier als Abkürzung dafür verwendet werden kann. Einige der Modi beinhalten eine verbindungsorientierte Kommunikation, andere eine verbindungslose Kommunikation. Einige Modi unterstützen den bidirektionalen Austausch von Anwendungsdaten, aber in einigen Fällen können die Anwendungsdaten nur in eine Richtung übertragen werden.

Normalerweise haben Anwendungsdaten keine kritische Beziehung zur Zeit, aber es gibt Fälle, in denen dies der Fall ist, und ein Gerät muss diese Beziehung aufrechterhalten, wenn es empfangene Daten verarbeitet. Bluetooth LE unterstützt isochrone Kommunikation sowohl in einem verbindungsorientierten als auch in einem verbindungslosen Modus. Isochrone Kommunikation ist für genau die Fälle gedacht, in denen Daten zeitgebunden sind. Audio ist ein gutes Beispiel für einen solchen Fall.

Bluetooth LE verfügt über eine Reihe von Funktionen zur Gerätepositionierung, die für standortbezogene Anwendungen vorgesehen sind.

- Bei der Richtungsbestimmung gibt es zwei verschiedene Methoden, mit denen die Richtung eines übertragenen Signals vom Empfänger berechnet werden kann. Die beiden Methoden heißen Ankunftswinkel (Angle of Arrival, AoA) und Abfahrtswinkel (Angle of Departure, AoD).

- Mit Bluetooth® Channel Sounding können zwei Geräte zusammenarbeiten und eines der Geräte kann seine Entfernung zum anderen Gerät sicher berechnen.

Eines der ursprünglichen Ziele bei der design dieser neuen Bluetooth-Technologievariante war die äußerst effiziente Nutzung der Energie. Es wurden Geräte ins Auge gefasst, die mit kleinen, münzgroßen Batterien tagelang, wochenlang oder noch länger betrieben werden konnten, und dieses Streben nach Energieeffizienz erklärt viele der bestimmenden Merkmale von Bluetooth LE. Insbesondere weist das design den Geräten asymmetrische Fähigkeiten und Verantwortlichkeiten zu, um sicherzustellen, dass Geräte mit einer relativ reichhaltigen Energiequelle, wie z. B. ein großer Smartphone-Akku, mehr von der schweren Arbeit übernehmen als vergleichbare Geräte, die mit Knopfzellenbatterien betrieben werden. Diese und andere design haben Bluetooth LE zu der drahtlosen Kommunikationstechnologie mit geringem Stromverbrauch gemacht, die es ist, und es für eine weit verbreitete Annahme in einer Vielzahl von Produkttypen in den folgenden Jahren positioniert.

4. Die Bluetooth LE

Ein tiefes und gründliches Verständnis von Bluetooth LE erfordert eine genaue Kenntnis der geltenden Spezifikationen. Die Architektur, die Verfahren und die Protokolle von Bluetooth LE sind vollständig in einer zentralen Spezifikation, der Bluetooth Core Specification, definiert. Die Art und Weise, wie Produkte Bluetooth verwenden, so dass sie interoperabel sind, wird durch Sammlungen von Spezifikationen zweier spezieller Typen abgedeckt, die als Profile und Dienste bekannt sind. Abbildung 1 veranschaulicht die Bluetooth LE und ihre Beziehungen.

Abbildung 1 - Die Bluetooth LE

4.1 Die Bluetooth Kernspezifikation

Die Bluetooth-Kernspezifikation ist die Hauptspezifikation für Bluetooth LE und Bluetooth Classic. Diese Spezifikation:

- definiert die Architektur der Bluetooth Technologie und die Schichten der verschiedenen Stack-Konfigurationen.

- beschreibt und definiert die wichtigsten Merkmale.

- definiert die formalen Verfahren, die den unterstützten Operationen zugrunde liegen.

- definiert die Protokolle, mit denen Geräte zwischen den relevanten Schichten des Stacks kommunizieren.

Die Bluetooth Kernspezifikation ist notwendigerweise eine umfangreiche Spezifikation.

Zusammenfassend definiert die Bluetooth Core Specification die Funktionsweise der Bluetooth Technologie und die Anforderungen an Entwickler bei der Implementierung eines Bluetooth Stacks oder einer oder mehrerer seiner Funktionen.

4.2 Profil-Spezifikationen

Wenn zwei Bluetooth LE über eine Verbindung kommunizieren, wird in der Regel eine Client/Server-Beziehung hergestellt. Die Server enthalten Zustandsdaten und die Clients verwenden diese Daten auf irgendeine Weise.

Stellen Sie sich einen Bluetooth Schlüsselanhänger vor, der Ihnen helfen soll, Ihre Schlüssel wiederzufinden, wenn Sie sie irgendwo abgelegt haben und sie vorübergehend verloren gegangen sind. Eine Smartwatch könnte als Client-Gerät und der Schlüsselanhänger Bluetooth als Server fungieren. Durch Drücken einer Taste auf dem Display der Smartwatch könnte der Zustand des Schlüsselanhängers geändert werden und er würde als Reaktion auf diese Änderung ein lautes Geräusch von sich geben, so dass Sie Ihre Schlüssel wiederfinden können.

Profilspezifikationen legen die Rollen fest, die verwandte Geräte (wie die Smartwatch und der Schlüsselanhänger) übernehmen, und definieren insbesondere das Verhalten des Client-Geräts und die Daten auf dem verbundenen Server, mit denen es arbeiten soll.

Im Beispiel des Schlüsselfinders wird das Verhalten der Smartwatch oder eines anderen Geräts, das die gleiche Rolle übernimmt, in der Spezifikation des Find-Me-Profils definiert.

4.3 Leistungsbeschreibung

Zustandsdaten auf Servern befinden sich in formal definierten Datenelementen, die als Merkmale und Deskriptoren[2] bekannt sind. Merkmale und Deskriptoren sind in Konstrukten gruppiert, die als Dienste bezeichnet werden. Dienste bieten einen Kontext, in dem den darin enthaltenen Merkmalen und Deskriptoren Bedeutung und Verhalten zugewiesen werden können.

Eine Dienstspezifikation definiert einen einzelnen Dienst zusammen mit den darin enthaltenen Merkmalen und Deskriptoren. Die Verhaltensweisen, die das Gerät, das den Dienst beherbergt, als Reaktion auf verschiedene Bedingungen und Zustandsdatenwerte zeigen soll, sind in der Dienstspezifikation festgelegt.

Eine Dienstspezifikation kann als Definition eines Aspekts des Verhaltens eines Servergeräts betrachtet werden.

Im Beispiel der Smartwatch und des Schlüsselanhängers fungiert der Schlüsselanhänger als Server und implementiert den Immediate Alert Service.

4.4 Protokollspezifikationen

Einige standardisierte Bluetooth Anwendungen erfordern ihre eigenen Protokolle, und diese Protokolle haben ihre eigenen Spezifikationen. Die primäre Spezifikation Bluetooth Mesh ist eine Protokollspezifikation.

4.5 Assigned Numbers

Bei verschiedenen Aspekten von Bluetooth LE werden eindeutige Bezeichner verwendet. Zum Beispiel haben alle Dienste, Merkmale und Deskriptoren einen universell eindeutigen Bezeichner (UUID), der den Typ des Dienstes, des Merkmals oder des Deskriptors identifiziert, auf den er sich bezieht, und nicht eine bestimmte Instanz auf einem bestimmten Gerät. Ein Unternehmen kann durch einen eindeutigen Unternehmensidentifikator identifiziert werden, der für bestimmte Profile erforderlich ist.

Die von der Bluetooth SIG zugewiesenen Kennungen werden als zugewiesene Nummern bezeichnet. Eine vollständige Liste dieser Kennungen finden Sie auf der Seite Zugewiesene Nummern auf der Website der Bluetooth SIG .

5. Der Bluetooth LE Stack

5.1 High-Level-Architektur

Der Bluetooth LE besteht aus einer Reihe von Schichten und Funktionsmodulen, von denen einige obligatorisch und einige optional sind. Diese Teile des Stacks sind über zwei große Architekturblöcke verteilt, die als host und den Controller, und eine logische Standardschnittstelle definiert die Art und Weise, wie diese beiden Komponenten miteinander kommunizieren können.

Der host ist oft so etwas wie ein Betriebssystem. Der Controller ist oft ein System auf einem Chip. Dies ist jedoch nicht unbedingt der Fall, und die Bluetooth-Spezifikationen schreiben keine derartigen Implementierungsdetails vor. Wichtig ist, dass host und Controller als getrennte logische Container in der Architektur fungieren, die auf irgendeine Weise in physisch getrennten Komponenten implementiert werden können, wobei eine Standardschnittstelle für die Kommunikation zwischen ihnen definiert ist. So kann ein Bluetooth-System aus host und Steuerungskomponenten verschiedener Hersteller bestehen.

Abbildung 2 veranschaulicht den Bluetooth LE , seine Schichten und ihre Verteilung auf die host und Controller-Komponenten.

DieController (HCI) stellt die logische Schnittstelle zwischen ihnen dar, ist aber keine physische Komponente als solche. HCI kann in Bezug auf den zugrunde liegenden physischen Transport auf verschiedene Weise implementiert werden, aber die logische oder funktionale Schnittstelle ist immer dieselbe.

LC3 ist der Low Complexity Communication Codec, der Standard-Audiocodec, der mit Bluetooth LE Audio verwendet wird. Er ist nicht Teil des Bluetooth LE , wird aber immer in LE-Audioprodukten zu finden sein, wobei die LC3-Komponente entweder im host oder im Controller implementiert ist, wie gezeigt.

Abbildung 3 zeigt das Standard-OSI-Referenzmodell für Kommunikationssysteme. Es ist anzumerken, dass der Bluetooth LE alle Schichten des OSI-Referenzmodells umfasst, im Gegensatz zu vielen anderen drahtlosen Systemen, die nur eine Teilmenge der OSI-Schichten abdecken, z. B. die physikalische und die Datenverbindungsschicht. Ein Vorteil der Bluetooth-Technologie als Full-Stack-Kommunikationssystem ist, dass es keine externen Abhängigkeiten von anderen Normungsgremien gibt. Solche Abhängigkeiten können die Entwicklung einer Technologie einschränken.

Abbildung 2 - Der Bluetooth LE

Abbildung 3 - Das OSI-Referenzmodell

Das Bluetooth-Mesh-Protokoll nutzt die Bluetooth LE und fügt dem Core Host eine Sammlung spezialisierter Schichten hinzu, die die Bluetooth-Mesh-Protokolle und -Verfahren implementieren. Der host kann jede der im host von Abbildung 2 gezeigten Schichten enthalten, die zur Unterstützung anderer Produktanforderungen, wie z. B. der Fähigkeit zum Verbindungsaufbau, erforderlich sind.

Diese Ressource deckt Bluetooth Mesh nicht weiter ab, und wer nach einer Bildungsressource zu diesem Thema sucht, sollte Abschnitt 18 konsultieren. Zusätzliche Ressourcen unten.

Abbildung 4 - Der Bluetooth Mesh

5.2 Die Schichten im Überblick

Nachfolgend eine Zusammenfassung der wichtigsten Aufgaben und Funktionen der einzelnen Schichten des Bluetooth LE , wie in Abbildung 2 dargestellt:

| Ebene | Zuständigkeiten |

|---|---|

| Physikalische Schicht | Definiert alle Aspekte der Bluetooth-Technologie, die mit der Verwendung von Funk (RF) zusammenhängen, einschließlich Modulationsschemata, Frequenzbänder, Kanalnutzung, Sender- und Empfängereigenschaften. Es werden mehrere verschiedene, unterstützte Kombinationen von Parametern der physikalischen Schicht definiert, die als PHYs bezeichnet werden. |

| Verbindungsschicht | Definiert Paketformate für die Luftschnittstelle, Bitstromverarbeitungsverfahren wie Fehlerprüfung, einen Zustandsautomaten und Protokolle für die Over-the-Air-Kommunikation und die Verbindungskontrolle; definiert verschiedene Möglichkeiten der Nutzung des zugrunde liegenden Funks für verbindungslose, verbindungsorientierte und isochrone Kommunikation, die als logische Transporte bezeichnet werden. |

| Channel Sounding | Bietet einem Gerät die Möglichkeit, Messungen vorzunehmen, die von der Anwendungsschicht zur Berechnung der Entfernung zu einem anderen Gerät verwendet werden können. Es sind zwei verschiedene Methoden integriert, nämlich die phasenbasierte Entfernungsmessung (PBR) und das Round-Trip-Timing (RTT). Diese Methoden können zusammen oder getrennt verwendet werden. |

| Isochrone Anpassungsschicht(ISOAL) | Ermöglicht die Verwendung unterschiedlicher Rahmendauern durch Geräte, die isochrone Kommunikation verwenden; führt Segmentierung und Wiederzusammensetzung von gerahmten PDUs oder Fragmentierung und Rekombination von ungerahmten PDUs durch. |

| Host (HCI) | Bietet eine genau definierte funktionale Schnittstelle für die bidirektionale Kommunikation von Befehlen und Daten zwischen der host und der Steuerung. |

| Logical Link Control and Adaptation Protocol(L2CAP) | Agiert als Protokollmultiplexer innerhalb des host und stellt sicher, dass die Protokolle von der entsprechenden host bedient werden; führt die Segmentierung und den Wiederzusammenbau von PDUs/SDUs zwischen der darunter liegenden und der darüber liegenden Schicht durch L2CAP durch. |

| Sicherheitsmanager-Protokoll(SMP) | Ein Protokoll, das bei der Durchführung von Sicherheitsverfahren wie dem Pairing verwendet wird. |

| Attribut-Protokoll(ATT) | Ein von einem ATT-Client und einem ATT-Server verwendetes Protokoll, das die Ermittlung und Verwendung von Daten in der Attributtabelle des Servers ermöglicht. |

| Generisches Attribut-Profil(GATT) | Definiert übergeordnete Datentypen, die als Dienste, Merkmale und Deskriptoren bekannt sind, in Bezug auf die zugrunde liegenden Attribute in der Attributtabelle. |

| Generisches Zugangsprofil(GAP) | Definiert Betriebsmodi und Verfahren, die im nichtverbundenen Zustand verwendet werden können, wie z. B. die Verwendung von Werbung für verbindungslose Kommunikation und die Durchführung der Geräteerkennung; definiert Sicherheitsstufen und -modi; definiert einige Benutzerschnittstellenstandards. |

6. Die physikalische Schicht

Die physikalische Schicht von Bluetooth LE definiert, wie der Funksender/-empfänger verwendet wird, um digitale Daten für die Übertragung und den Empfang zu kodieren und zu dekodieren, sowie andere funkbezogene Parameter und Eigenschaften, die gelten.

6.1 Frequenzband

Bluetooth LE arbeitet im unlizenzierten 2,4-GHz-Band im Bereich von 2400 MHz bis 2483,5 MHz, das in 40 Kanäle mit einer Breite von jeweils 2 MHz unterteilt ist. Wie die Kanäle genutzt werden, wird durch die Verbindungsschicht und die Datentransportarchitektur festgelegt.

Abbildung 5 - Bluetooth LE

6.2 Modulationsschemata

6.2.1 Gaußsche Frequenzumtastung

Um digitale Daten aus höheren Schichten des Stacks vor der Übertragung zu kodieren und empfangene Funksignale zu dekodieren, verwendet Bluetooth LE ein Modulationsverfahren namens Gaussian Frequency Shift Keying (GFSK). Bei GFSK wird ein Signal mit der Mittenfrequenz des ausgewählten Kanals (dem Träger) um einen bestimmten Betrag nach oben verschoben, um einen digitalen Wert von 1 darzustellen, oder um denselben Betrag nach unten, um einen binären Wert von 0 darzustellen. Das Signal wird nach Gauß gefiltert, um Rauschen zu reduzieren, das mit abrupten Frequenzänderungen einhergehen kann.

Abbildung 6 veranschaulicht den grundlegenden Frequenzumtastungsprozess. Man beachte, dass der Betrag, um den die Frequenz verschoben wird, als Frequenzabweichung bezeichnet wird und je nach verwendeter PHY-Variante mindestens +/-185 kHz oder mindestens 370 kHz beträgt(PHY wird in Abschnitt 6.3 PHY-Varianten erläutert).

Abbildung 6 - Frequenzumtastung in Bluetooth LE

6.2.2 Amplitudenumtastung

Channel Sounding (siehe Abschnitt 8.Bluetooth® Channel Sounding) verwendet für einige seiner Übertragungen ein Modulationsverfahren namens Amplitude Shift Keying (ASK). ASK ist ein binäres Modulationsverfahren mit zwei Symbolzuständen. Der erste wird durch die Übertragung einer Trägerwelle mit fester Amplitude auf einer ausgewählten Frequenz für eine bestimmte Zeitspanne dargestellt. Der zweite ist das Fehlen einer Übertragung auf der gewählten Frequenz und während des entsprechenden Zeitraums.

6.3 PHY-Varianten

Es wird eine Reihe von Modulationsschema-Varianten definiert. Jede Variante wird als PHY bezeichnet und hat einen Namen. Die Übertragungsgeschwindigkeiten auf der Bitübertragungsschicht werden in Symbolen pro Sekunde und nicht in Bits pro Sekunde gemessen, da die Bitübertragungsschicht nur mit analogen Funkartefakten und nicht mit digitalen Konzepten arbeitet.

Bluetooth LE verwendet ein binäres Modulationsverfahren, d. h. ein einzelnes analoges Symbol steht für ein einzelnes digitales Bit weiter oben im Stapel.

Jeder PHY enthält eine Eigenschaft, die als Product (BT) bezeichnet wird. BT bestimmt das Verhältnis zwischen der Bandbreite eines Signals und der Dauer der Symbole.

Der Wert von BT wirkt sich auf die Form und die Spanne der Funkimpulse aus, die die Symbole bilden. Ein höherer BT-Wert führt zu einem schmaleren, quadratischeren Impuls und ein niedrigerer Wert zu einer breiteren, runderen Impulsform.

Die in der Bluetooth Core Specification definierten PHY-Typen werden im Folgenden zusammengefasst:

- Der LE 1M PHY verwendet eine Symbolrate von 1 Msym/s mit einer erforderlichen Frequenzabweichung von mindestens 185 kHz und verwendet keine spezielle Kodierung. Alle Geräte müssen den LE 1M PHY unterstützen. BT=0,5 mit diesem PHY.

- LE 2M PHY ist ähnlich wie LE 1M, verwendet jedoch eine Symbolrate von 2 Msym/s und hat eine erforderliche Frequenzabweichung von mindestens 370 kHz. Die Unterstützung des LE 2M PHY ist optional. BT=0,5 mit diesem PHY.

- Der LE 2M 2BT PHY hat eine Symbolrate von 2 Msym/s, erfordert aber einen Frequenzhub von mindestens 420 kHz. BT=2 mit diesem PHY.

- Der LE-codierte PHY verwendet eine Symbolrate von 1 Msym/s, aber die Pakete unterliegen einer Kodierung namens Forward Error Correction (FEC), die in der Verbindungsschicht definiert ist. FEC erhöht die effektive Reichweite der Übertragungen, reduziert aber die Anwendungsdatenrate. Die Unterstützung für den LE Coded PHY ist optional. BT=0,5 mit diesem PHY.

Es folgt ein Vergleich der PHYs:

| LE 1M | LE Kodiert S=2 | LE Kodiert S=8 | LE 2M | LE 2M 2BT | |

|---|---|---|---|---|---|

| Symbolrate | 1 M/s | 1 M/s | 1 M/s | 2 M/s | 2 M/s |

| Protokoll Datenrate | 1 Mbit/s | 500 Kbit/s | 125 Kbit/s | 2 Mbit/s | 2 Mbit/s |

| Ungefähre Max. Anwendungsdatenrate | 800 kbps | 400 kbps | 100 kbps | 1400 kbps | N/A[3] |

| BT | 0.5 | 0.5 | 0.5 | 0.5 | 2.0 |

| Fehlererkennung | CRC | CRC | CRC | CRC | N/A[4] |

| Fehlerkorrektur | KEINE | FEC | FEC | KEINE | KEINE |

| Reichweite Multiplikator (ca.) | 1 | 2 | 4 | 0.8 | 0.8 |

| Anforderung | Obligatorisch | Optional | Optional | Optional | Optional |

Definitionen

| Begriff | Definition |

|---|---|

| Symbolrate | Die Rate, mit der analoge Symbole auf der Bitübertragungsschicht übertragen werden. |

| Protokoll Datenrate | Die Übertragungsrate von Bits, die sich auf Bluetooth-Protokolldateneinheiten (PDUs) beziehen, einschließlich ihrer Anwendungsdaten-Nutzlast, aber ohne FEC-Daten, die in Paketen enthalten sind, wenn der LE Coded PHY verwendet wird. |

| Ungefähre Max. Anwendungsdatenrate | Eine ungefähre maximale Rate, mit der Anwendungsdaten zwischen Anwendungen auf kommunizierenden Geräten übertragen werden können. Anwendungsdaten werden im Nutzlastteil verschiedener PDUs transportiert, der Rest der Protokolldatenrate wird von Bluetooth-Protokolldaten verbraucht. |

| CRC | Zyklische Redundanzprüfung. Ein Feld, das bei der Erkennung von Übertragungsfehlern verwendet wird. Dieses Feld und seine Verwendung werden auf der Verbindungsschicht definiert. |

6.4 Zeiteinteilung

Ein Bluetooth LE ist ein Halbduplex-Gerät, das zwar senden und/oder empfangen kann, aber nicht beides gleichzeitig. Allerdings werden alle PHYs in einem Time Division Duplex (TDD) Schema verwendet, so dass der Anschein eines Vollduplex-Funkgerätes entsteht.

6.5 Sendeleistung und Empfangsempfindlichkeit

Die physikalische Schicht definiert die Eigenschaften des Senders, einschließlich der Anforderungen an die Ausgangsleistung, für die in der Spezifikation festgelegt ist, dass der Ausgangsleistungspegel bei der maximalen Leistungseinstellung zwischen 0,01 mW (-20 dBm) und 100 mW (+20 dBm) liegen muss.

Die Regulierungsbehörden[5] in verschiedenen Teilen der Welt können diese Anforderungen außer Kraft setzen, und die Anwender müssen sicherstellen, dass die Geräte mit den geltenden lokalen Vorschriften übereinstimmen.

Die Empfindlichkeit des Empfängers ist definiert als der Empfänger-Eingangspegel, bei dem eine bestimmte Bitfehlerrate (BER) auftritt. Die angegebene BER variiert je nach Länge eines empfangenen Pakets, da die Verbindungsschicht an jedes Paket ein einzelnes CRC-Feld (Cyclic Redundancy Check) anhängt und dieses als Mechanismus zur Erkennung eines oder mehrerer fehlerhafter Bits im decodierten Paket verwendet. Da die Pakete unterschiedlich lang sind und pro Paket ein CRC-Feld vorhanden ist, beeinflusst die Länge des Pakets die berechnete BER.

Bei Diskussionen über die Empfindlichkeit von Bluetooth LE wird in der Regel eine BER von 0,1 % angegeben. Dies ist die maximale Fehlerrate, die für Pakete mit einer Länge von bis zu 37 Oktetten zulässig ist.

Weitere von der Bitübertragungsschicht festgelegte Empfängereigenschaften sind das Interferenzverhalten, die Sperrung außerhalb des Bandes, die Intermodulationseigenschaften, der maximal nutzbare Eingangspegel und die erforderliche Genauigkeit der Empfangsstärkeanzeige (RSSI).

6.6 Antennenumschaltung

6.6.1 Richtungsbestimmung

Bluetooth LE unterstützt zwei Methoden zur Berechnung der Richtung, aus der ein empfangenes Signal gesendet wurde. Die erste Methode wird als Ankunftswinkel (AoA) und die zweite als Abfahrtswinkel (AoD) bezeichnet. Bei beiden Methoden verfügt ein Gerät über eine Reihe von Antennen und schaltet bei der Übertragung von Peilsignalen (AoD-Methode) oder beim Empfang von Signalen (AoA-Methode) von einer Antenne zur anderen um. Bei den Peilsignalen handelt es sich um Bluetooth-Standardpakete, die ein CTE-Feld (Constant Tone Extension) enthalten.

Antennengruppen gibt es in vielen verschiedenen Ausführungen, und die Umschaltung von einer Antenne auf die nächste kann nach einer Reihe unterschiedlicher Schaltmuster erfolgen. Dies wird vom host gesteuert, aber die Bitübertragungsschicht definiert auch einige allgemein gültige Regeln für den Prozess der Antennenumschaltung, damit verbundene Empfängeranforderungen und einige nützliche Definitionen.

Die Bluetooth Core Specification behandelt dieses Thema ausführlicher in Band 6, Teil A, Abschnitt 5. Weitere Informationen über die AoA- und AoD-Peilungsfunktion finden Sie im Dokument Bluetooth Core Specification Version 5.1 Feature Overview.

6.6.2 Bluetooth Channel Sounding

Bluetooth Channel Sounding erlaubt die Verwendung von mehr als einer Antenne in einem oder beiden Geräten und hat Regeln für die Auswahl und Verwendung von Antennen. Siehe Abschnitt 8.Bluetooth® Channel Sounding.

7. Die Verbindungsschicht

7.1 Überblick über die Verbindungsschicht

Die Link-Layer-Spezifikation ist fast der größte Abschnitt der Bluetooth LE , der zweitgrößte nach dem Abschnitt " Host Controller Interface Functional Specification". Allerdings ist sie wohl auch die komplizierteste.

Die Verbindungsschicht hat viele Aufgaben. Sie definiert mehrere Arten von Paketen, die über die Luft übertragen werden, und ein zugehöriges Luftschnittstellenprotokoll. Ihr Betrieb unterliegt einer genau definierten Zustandsmaschine. Je nach Zustand kann die Verbindungsschicht auf ganz unterschiedliche Weise arbeiten, ausgelöst durch eine Reihe von Ereignissen. Es sind zahlreiche Kontrollverfahren definiert, die den Zustand einer Verbindung oder Verbindungsnutzungsparameter beeinflussen. Die Auswahl und Klassifizierung von Funkkanälen ist in der Spezifikation der Verbindungsschicht festgelegt.

Die Verbindungsschicht unterstützt sowohl verbundene als auch verbindungslose Kommunikation sowie deterministisches und (leicht) zufälliges Ereignis-Timing. Sie unterstützt sowohl die Punkt-zu-Punkt-Kommunikation zwischen zwei Geräten als auch die Eins-zu-Viel-Kommunikation von einem Gerät zu einer unbegrenzten Anzahl von empfangenden Geräten gleichzeitig. Je nachdem, wie die Verbindungsschicht verwendet wird, kann die Übertragung von Anwendungsdaten bidirektional sein oder nur in eine Richtung erfolgen.

Ein Großteil der Vielseitigkeit von Bluetooth LE liegt in der Ausgereiftheit der Verbindungsschicht begründet.

7.2 Pakete

Die Verbindungsschicht definiert zwei Pakettypen. Der erste wird von den uncodierten PHYs (siehe Abbildung 7), LE 1M und LE 2M und der zweite vom LE Coded PHY (siehe Abbildung 8) verwendet. Beachten Sie, dass andere Pakettypen für die Verwendung mit Channel Sounding definiert sind.

Abbildung 7 - Link-Layer-Paketformat für die LE uncodierten PHYs

Abbildung 8 - Link-Layer-Paket für den LE Coded PHY

Beide Pakettypen enthalten die Felder Präambel, Zugangsadresse und CRC. In Tabelle 1 wird jedes dieser gemeinsamen Felder erläutert.

| Link Layer Packet Field Name | Beschreibung |

|---|---|

| Präambel | Die Präambel ermöglicht es dem Empfänger, sich genau auf die Frequenz des Signals zu synchronisieren, eine automatische Verstärkungsregelung durchzuführen und das Symboltiming zu schätzen. |

| Zugang Adresse | Die Zugangsadresse wird von den Empfängern verwendet, um Signale von Hintergrundgeräuschen zu unterscheiden und um festzustellen, ob ein Paket für das empfangende Gerät relevant ist oder nicht. Ein Paar verbundener Geräte tauscht zum Beispiel Pakete mit derselben zufällig zugewiesenen Zugangsadresse aus. Geräte, die nicht an der Verbindung teilnehmen, ignorieren solche Pakete, da die Zugangsadresse für sie nicht relevant ist. In ähnlicher Weise verwenden alle Legacy-Werbepakete dieselbe Zugangsadresse mit dem Wert 0x8E89BED6, was bedeutet, dass diese Pakete von allen Geräten empfangen werden können. |

| CRC | Die zyklische Redundanzprüfung wird zur Fehlererkennung verwendet. Sein Wert wird vom Sender anhand des Wertes der anderen Bits im Paket berechnet. Beim Empfang eines Pakets berechnet das empfangende Gerät ebenfalls einen CRC-Wert aus den Werten der Bits im empfangenen Paket mit Ausnahme derjenigen, die das CRC-Feld bilden. Der vom Empfänger berechnete CRC-Wert wird dann mit dem Wert des CRC-Feldes im Paket verglichen. Wenn die beiden CRC-Werte übereinstimmen, wurde das Paket korrekt empfangen. Andernfalls wird davon ausgegangen, dass es ein oder mehrere fehlerhafte Bits enthält. |

Tabelle 1 - Gemeinsame Link-Layer-Paketfelder

Das PDU-Feld von Link-Layer-Paketen kann eine Vielzahl verschiedener Protokolldateneinheiten (PDUs) enthalten, je nachdem, wie Bluetooth LE verwendet wird. Die Constant Tone Extension (CTE) ist nur vorhanden, wenn eine der beiden Peilmethoden (Ankunftswinkel oder Abfahrtswinkel) verwendet wird.

Die PDU- und CRC-Felder werden vor der Übertragung des Pakets einem so genannten Whitening-Prozess unterzogen. Der Zweck des Whitening ist es, lange Sequenzen von Nullen oder Einsen in den Paketen zu vermeiden, da dies zu einer Drift der Frequenzverriegelung des Empfängers führen kann. Der Whitening-Prozess wird vom Empfänger rückgängig gemacht, um den ursprünglichen Bitstrom wiederherzustellen, bevor der CRC überprüft wird.

Das PDU-Feld kann verschlüsselt sein. In diesem Fall enthält es ein Feld für die Prüfung der Nachrichtenintegrität, das vor Manipulationen der PDU schützt[6].

Wenn der LE Coded PHY verwendet wird, wird der Bitstrom vor der Übertragung einer zusätzlichen Verarbeitung unterzogen. Die Anwendung eines FEC-Codierers (Forward Error Correction), gefolgt von einem Pattern Mapper, erzeugt zusätzliche Daten, die vom Empfänger verwendet werden, wenn er diese Prozesse in umgekehrter Richtung anwendet und, wenn möglich, den Wert aller Bits mit dem falschen Wert korrigiert.

7.3 Zustandsmaschine

Die Verbindungsschicht wird von einer Zustandsmaschine gesteuert, die in Abbildung 9 dargestellt ist.

Abbildung 9 - Die Link Layer State Machine

Einzelheiten zu den einzelnen Zuständen finden Sie in der Spezifikation der Verbindungsschicht. Eine Zusammenfassung findet sich in Tabelle 2. Beachten Sie, dass einige Begriffe später in diesem Abschnitt erklärt werden.

| Staat | Beschreibung |

|---|---|

| Bereitschaft | Gerät sendet und empfängt keine Pakete. |

| Initiieren | Reagiert auf Werbepakete von einem bestimmten Gerät, um eine Verbindung anzufordern. |

| Werbung | Überträgt Werbepakete und verarbeitet möglicherweise Pakete, die als Antwort auf Werbepakete von anderen Geräten gesendet werden. |

| Verbindung | In einer Verbindung mit einem anderen Gerät. |

| Scannen | Lauschen auf Werbepakete von anderen Geräten. |

| Isochroner Rundfunk | Sendet isochrone Datenpakete. |

| Synchronisierung | Lauscht auf periodische Werbung, die zu einem bestimmten Werbezug gehört, der von einem bestimmten Gerät gesendet wird. |

Tabelle 2 - Zustände der Verbindungsschicht

Im Zustand "Verbindung" sind zwei wichtige Geräterollen definiert. Diese sind die zentrale Rolle und die periphere Rolle. Ein Gerät, das eine Verbindung initiiert und vom Zustand "Initiating" in den Zustand "Connection" übergeht, übernimmt die Rolle "Central". Ein Gerät, das eine Verbindungsanfrage annimmt und vom Zustand "Werbung" in den Zustand "Verbindung" übergeht, nimmt die Rolle "Peripherie" ein.

Nehmen wir zum Beispiel ein Herzfrequenzmessgerät, das die Messwerte an ein Smartphone zur Verwendung durch eine Anwendung überträgt. Normalerweise würde das Smartphone die zentrale Rolle und der Herzfrequenzmesser die periphere Rolle übernehmen. Das Smartphone erkennt das Überwachungsgerät, indem es nach dessen Werbepaketen sucht, und initiiert dann, in der Regel unter Mitwirkung des Benutzers, eine Verbindung zu ihm. Sobald die Verbindung hergestellt ist, weist die Smartphone-Anwendung das Überwachungsgerät gemäß den in der Spezifikation des Herzfrequenzprofils festgelegten zusätzlichen Verfahren an, Messungen über die Verbindung zu senden.

Eine Instanz des Zustandsautomaten darf sich jeweils nur in einem Zustand befinden. Eine Verbindungsschichtimplementierung kann mehr als eine Zustandsmaschineninstanz gleichzeitig unterstützen.

Nicht alle Rollen- und Statuskombinationen sind zulässig. Die Bluetooth Core Specification enthält weitere Einzelheiten dazu.

7.4 Kanalauswahl

Wie in Abschnitt 6.1 Frequenzband beschrieben, unterteilt Bluetooth LE das 2,4-GHz-Frequenzband in 40 Kanäle. Die Verbindungsschicht steuert, wie diese Kanäle verwendet werden, was wiederum von der allgemeinen Art und Weise abhängt, in der Bluetooth LE für die Kommunikation verwendet wird (genauer gesagt, vom aktuellen physikalischen Kanal - dies wird in Abschnitt 7.7 Die Datentransportarchitektur behandelt).

Bluetooth LE nutzt Spreizspektrumsverfahren auf verschiedene Weise, um Daten über mehrere Kanäle im Laufe der Zeit zu übertragen. Dadurch wird die Wahrscheinlichkeit von Kollisionen verringert, was die Kommunikation zuverlässiger macht.

Ein bekanntes Beispiel für ein Spreizspektrumverfahren, das in Bluetooth LE verwendet wird, ist das adaptive Frequenzsprungverfahren. Dabei wird der für die Paketkommunikation verwendete Funkkanal in regelmäßigen Abständen gewechselt. Die Kanäle werden mit Hilfe eines Kanalauswahlalgorithmus und einer Datentabelle, der so genannten Kanalkarte , ausgewählt, die jeden Kanal entweder als benutzt oder als unbenutzt klassifiziert. Die Implementierungen können die Qualität der Kommunikation auf den einzelnen Kanälen überwachen, und wenn sich herausstellt, dass ein Kanal schlecht funktioniert, z. B. aufgrund von Störungen durch andere Quellen, kann die Kanaltabelle aktualisiert werden, um die Klassifizierung dieses Kanals auf " unbenutzt" zu setzen, wodurch sichergestellt wird, dass dieser Kanal nicht mehr vom Algorithmus ausgewählt wird. Auf diese Weise passt sich der Algorithmus für die Kanalauswahl an die jeweiligen Bedingungen an und optimiert die Leistung so zuverlässig wie möglich.

Wie Funkkanäle verwendet werden, wird weiter unten bei der Erörterung der logischen Bluetooth LE und der zugehörigen physischen Kanäle beschrieben.

7.5 Filterrichtlinien

Die Verbindungsschicht hat die Möglichkeit, empfangene Pakete nach verschiedenen Kriterien zu filtern, damit höhere Schichten des LE-Stapels nicht mit irrelevanten PDUs belastet werden, die zu verarbeiten sind. Die Kriterien, nach denen entschieden wird, ob Pakete gefiltert und verworfen oder zur weiteren Verarbeitung ausgewählt werden sollen, werden durch eine Reihe von Link-Layer-Filterrichtlinien definiert und implementiert. Es gibt getrennte Filterrichtlinien für jeden der Link-Layer-Zustände Advertising, Scanning, Initiating und Periodic Sync Establishment.

Filterrichtlinien arbeiten in einem Modus, von denen eine Reihe für die verschiedenen Zustände der Verbindungsschicht definiert sind. Der Standardmodus führt in allen Fällen dazu, dass keine Paketfilterung stattfindet. Andere Modi verwenden oft eine Liste von Geräteadressen, die Filter Accept List. In diesen Fällen werden Pakete von Geräten, deren Adresse in der Filter Accept List enthalten ist, wahrscheinlich nicht gefiltert, obwohl es andere Details zu den Bedingungen gibt, die in den verschiedenen Modi angewandt werden, und die Bluetooth Core Spezifikation für Details konsultiert werden sollte. Dies ist jedoch das Grundprinzip, das in den meisten Fällen zum Tragen kommt.

Anwendungen können die Filter-Akzeptanzliste auffüllen und die Filterrichtlinienmodi für die verschiedenen Link-Layer-Zustände mit HCI-Befehlen konfigurieren.

Eine Reihe spezieller Filterrichtlinienmodi, die so genannten "Decision Scanning Filter Policy Modes", sind definiert, und ihre Verwendung wird als " Decision-Based Advertising Filtering" (DBAF) bezeichnet. Mit DBAF können anspruchsvollere Filterbedingungen formuliert werden als nur die Prüfung auf Mitgliedschaft in der Filter-Akzeptanzliste.

DBAF-Modi gelten nur für die Scanning-Filter-Richtlinie und nur für bestimmte Arten von Werbe-PDUs, die auf den Primärkanälen empfangen werden. Die Filterung, die durch einen Entscheidungs-Scanning-Filtermodus herbeigeführt werden kann, gilt nur für erweiterte Werbepakete; weitere Informationen zu diesem Thema sind in Abschnitt 7.7.2.3.7 Entscheidungsbasierte Werbefilterung zu finden.

7.6 Überwachung der Inserenten

7.6.1 Filtern und Anwesenheit

Werbung kann als verbindungsloser Kommunikationstransport verwendet werden, aber wahrscheinlich wird sie am häufigsten zur Geräteerkennung eingesetzt.

Die Geräteerkennung umfasst das Scannen nach Werbepaketen. Der Empfang von Werbepaketen dient als Hinweis darauf, dass das werbende Gerät vorhanden ist, und kann je nach Art der Werbe-PDU anzeigen, dass das Gerät für eine Verbindung zur Verfügung steht.

Werbepakete werden vom controller verarbeitet, wobei die Einzelheiten in der Spezifikation für die Verbindungsschicht festgelegt sind. Die Host des Stapels werden über das Eintreffen von Werbepaketen und deren Inhalt anhand von Ereignissen informiert, die über dieController gesendet werden.

Ein Gerät kann zwischen einmal alle 20 Millisekunden und einmal alle 10,24 Sekunden werben. Da jedes empfangene Paket ein HCI-Ereignis erzeugt und vielleicht jedes Ereignis zu einem Aufruf einer Funktion in einer Anwendung führt, kann Werbung den physischen HCI-Transport, den Bluetooth LE Host und die Anwendung stark belasten. Glücklicherweise gibt es eine Möglichkeit, dies zu vermeiden.

Wenn die Werbung nur zum Zweck der Geräteerkennung erfolgt, ändert sich der Inhalt der Pakete normalerweise nicht. Eine Anwendung, die Anrufe zu empfangen wünscht, die sich auf empfangene Werbepakete beziehen, verwendet einen von mehreren HCI-Befehlen, um die Steuerung entsprechend zu instruieren. Mit diesen HCI-Befehlen kann die Anwendung angeben, ob sie Duplikate empfangen möchte oder nicht, indem sie einen treffend benannten HCI-Befehlsparameter, Filter_Duplicates, setzt. Wenn die Filterung von Duplikaten festgelegt ist, wird ein HCI-Ereignis und der damit verbundene Aufruf an die Anwendung nur einmal pro Werbegerät ausgeführt.

Das Filtern von Duplikaten hat jedoch auch einen potenziellen Nachteil. Bei ungefilterten Duplikaten weiß eine Anwendung im Allgemeinen, ob sich ein Gerät von Interesse noch in Reichweite befindet oder nicht. Wenn die Anwendung keine Werbedaten für das Gerät mehr erhält, kann davon ausgegangen werden, dass es sich nicht mehr in Reichweite befindet. Bei aktivierter Duplikatfilterung ist das Ausbleiben von HCI-Werbeereignissen jedoch kein Indikator mehr dafür, dass sich das Gerät nicht mehr in Reichweite befindet. Es ist genauso wahrscheinlich, dass es doppelte Pakete sendet und dass diese gefiltert werden.

Der Verlust des Bewusstseins für das Vorhandensein eines Geräts wird zu einem besonderen Problem, wenn es darum geht, Verbindungen herzustellen. Stellen Sie sich eine Anwendung vor, die nach Geräten in Reichweite sucht und dem Benutzer auf einer grafischen Benutzeroberfläche eine Liste zur Auswahl vorlegt. Wenn der Benutzer eine Auswahl trifft, fordert die Anwendung eine Verbindung mit dem ausgewählten Gerät an. Wenn eine Verbindung hergestellt werden muss, muss der LE-Controller zunächst eine Abtastung mit hohem Tastverhältnis durchführen. So kann er ein Werbepaket vom Zielgerät empfangen, bevor er ihm auf demselben Kanal mit einer Verbindungsanforderung antwortet. High Duty Cycle ist eine aggressive Form des Scannens, bei der die Werbepakete schnell empfangen werden, aber viel Energie verbraucht wird. Dies ist in Ordnung, wenn das Gerät, mit dem eine Verbindung hergestellt werden soll, noch in Reichweite ist, aber wenn es sich in der Zeit, die der Benutzer für die Auswahl benötigt hat, aus der Reichweite entfernt hat, dann ist dieser relativ teure Scanvorgang eine Energieverschwendung.

Manchmal lohnt es sich für eine Anwendung nicht, eine Verbindung zu einem Gerät herzustellen, wenn die Signalstärke gering ist, weil dies zum Beispiel ein Indikator dafür sein könnte, dass das Gerät nicht nahe genug ist, damit der Anwendungsfall der Anwendung sinnvoll ist. Technisch gesehen könnte das Gerät also noch vorhanden sein, aber bei einer geringen Signalstärke wäre das Scannen, um eine Verbindung herzustellen, genauso eine Energieverschwendung, wie wenn es sich tatsächlich außerhalb der Reichweite befindet.

Mit der Funktion zur Überwachung von Werbeträgern können doppelte Werbepakete gefiltert werden, ohne dass die Möglichkeit verloren geht, zu verfolgen, ob ein Gerät noch vorhanden ist und ob seine Signalstärke ausreicht, um eine Verbindung zu ihm herzustellen.

7.6.2 Werbebeobachtung nutzen

Der LE-Controller verwaltet eine Liste, die so genannte " Monitored Advertisers List". Anwendungen können HCI-Befehle verwenden, um ein Gerät von Interesse zusammen mit einem niedrigen RSSI-Schwellenwert (Signalstärke), einem hohen RSSI-Schwellenwert und einem Zeitüberschreitungswert zur Liste hinzuzufügen. Die Anwendung kann die Überwachung von Werbeträgern auch mit einem anderen Befehl aktivieren oder deaktivieren.

In Tabelle 3 werden die Parameter erläutert, die bestimmen, wie sich die Überwachung von Werbetreibenden für ein bestimmtes Gerät verhält.

| Kenngröße(n) | Beschreibung |

|---|---|

| Adresse und Adresstyp | Die Adresse und der Adresstyp des zu überwachenden Geräts. Diese beiden Parameter ermöglichen es dem Controller, das Gerät zu identifizieren und zu überwachen. |

| RSSI-Schwellenwert niedrig | Wenn das RSSI aller Werbepakete von diesem überwachten Gerät für die durch den Time Out-Parameter angegebene Zeitspanne auf oder unter diesem Wert bleibt, wird gesagt, dass ein Signalverlust aufgetreten ist. Wenn dies geschieht, benachrichtigt die Steuerung den host mit einem HCI LE Monitor Advertisers Report-Ereignis. Der Status dieses Geräts wird auf " Awaiting RSSI High" gesetzt . |

| RSSI-Schwellenwert Hoch | Wenn die RSSI eines von diesem überwachten Gerät empfangenen Werbepakets größer oder gleich diesem Wert ist und der Gerätestatus " Awaiting RSSI High" lautet, sendet die Steuerung ein HCI LE Monitor Advertisers Report-Ereignis an den host , um ihn zu informieren, dass das Gerät in Reichweite ist. Der Status für dieses Gerät wird gelöscht oder gesetzt, um anzuzeigen, dass es nicht mehr auf ein RSSI über dem hohen Schwellenwert wartet, und der Timer, der zur Überwachung des Signalverlusts verwendet wird, wird zurückgesetzt. |

| Auszeit | Eine Zeit in Sekunden, die für die Überwachung des Signalverlusts verwendet wird. Wenn in diesem Zeitraum keine RSSI-Messung den Parameter RSSI-Schwelle niedrig überschreitet, gilt der Signalverlust als eingetreten. |

Tabelle 3 - Parameter für überwachte Anzeigenkunden

Die Funktion zur Überwachung von Werbeträgern kann unabhängig davon verwendet werden, ob der controller angewiesen wurde, doppelte Werbeträger zu filtern oder nicht, ist aber eindeutig am nützlichsten, wenn sie bei aktivierter Filterung von doppelten Werbeträgern verwendet wird.

Abbildung 10 zeigt ein Beispielszenario mit der Funktion zur Überwachung von Werbeträgern. Der linke Teil des Diagramms ist ein Sequenzdiagramm, das den Empfang von Werbepaketen, die Verwendung von HCI-Befehlen zur Konfiguration der Werbeüberwachung und anschließend die Verwendung von HCI-Ereignissen zur Anzeige der Ein- und Ausfahrt des werbenden Geräts auf der Grundlage der konfigurierten RSSI-Schwellenwerte zeigt. Die rechte Seite zeigt die sich ändernde Signalstärke des Geräts und die daraus resultierenden Zustandsänderungen und HCI-Ereignisse.

Abbildung 10 - Beispiel für die Überwachung von Werbetreibenden

Tabelle 4 erläutert die beschrifteten Punkte von Interesse in Abbildung 10.

| Punkt | Erläuterung |

|---|---|

| A | Der host des Scanners fragt zunächst das Steuergerät, wie viele Werbegeräte es überwachen kann. Der host fügt dann ein Gerät zur Liste hinzu, zusammen mit den Werten für RSSI niedrig, RSSI hoch und Timeout (nicht gezeigt). Schließlich weist der host das Steuergerät an, die Überwachung der Werbeträger zu aktivieren. |

| B | An diesem Punkt beginnt die Abbildung, Werbepakete zu zeigen, die vom ersten Gerät übertragen werden. Beachten Sie, dass das Gerät bereits vor diesem Zeitpunkt Werbung gesendet haben könnte, aber die Pakete werden erst ab diesem Zeitpunkt angezeigt. Empfangene Pakete haben einen RSSI-Wert, der größer ist als der konfigurierte niedrige Schwellenwert, so dass der Timer für das überwachte Gerät bei jedem empfangenen Paket zurückgesetzt wird. |

| C | Die nächsten Pakete, die nach Punkt C empfangen werden, haben einen RSSI-Wert, der unter dem niedrigen RSSI-Schwellenwert liegt, so dass der Timer an Punkt C zum letzten Mal zurückgesetzt wird und ab diesem Punkt läuft. |

| D | Es wird nun eine Reihe von Paketen mit niedrigem RSSI empfangen, und am Punkt D tritt eine Zeitüberschreitung ein. Der Controller zeigt dem host den Signalverlust an, indem er ein Ereignis LE Monitor Advertisers Report mit condition == 0x00 sendet. Das Gerät befindet sich nun im Zustand "Awaiting High RSSI" (Warten auf hohes RSSI) in der Liste der Überwachungswerber. |

| E | Zum Zeitpunkt E wird das erste einer Reihe von Paketen empfangen, deren RSSI über dem niedrigen Schwellenwert liegt. Für jedes dieser Pakete wird der Timer zurückgesetzt. |

| F | Am Punkt F überschreitet der RSSI-Wert den Schwellenwert RSSI High. Der host wird über ein vom Controller gesendetes Ereignis LE Monitor Advertisers Report mit condition == 0x01 informiert, dass das überwachte Gerät wieder mit einem ausreichend starken Signal in Reichweite ist. Das Gerät befindet sich nicht mehr im Zustand "Awaiting High RSSI". |

Tabelle 4 - Interessante Punkte im Beispiel der Überwachung von Anzeigenkunden

7.7 Die Datentransportarchitektur

Der Abschnitt über die Architektur der Bluetooth-Kernspezifikation definiert eine Reihe von Konzepten, die zusammengenommen die Bluetooth-Datentransportarchitektur bilden. Zu den wichtigsten dieser Konzepte gehören der physikalische Kanal, die physikalische Verbindung, die logische Verbindung und der logische Transport. Bestimmte Kombinationen sind für die Unterstützung verschiedener Anwendungstypen definiert, die jeweils besondere Anforderungen in Bezug auf Topologie, Timing, Zuverlässigkeit und Kanalnutzung haben.

Ein physikalischer Kanal definiert eine von mehreren verschiedenen Möglichkeiten der Kommunikation über Bluetooth. Zum Beispiel kann die Kommunikation zwischen zwei verbundenen Geräten über den LE Piconet Physical Channel erfolgen, der ein adaptives Frequenzsprungverfahren über 37 Kanäle beinhaltet. Alternativ dazu kann der LE Advertising Physical Channel für die verbindungslose Broadcast-Kommunikation von einem Gerät zu einer unbegrenzten Anzahl anderer Geräte verwendet werden. Der LE Periodic Physical Channel kann ebenfalls für die Übertragung von Daten verwendet werden, allerdings auf einer regelmäßigen Basis mit einem deterministischen Zeitplan. Beobachtergeräte (Empfänger) sind in der Lage, diesen Zeitplan zu bestimmen und ihn zur Synchronisierung ihrer Abtastzeitpläne zu verwenden.

Eine Physikalische Verbindung basiert auf einem einzigen physikalischen Kanal und spezifiziert bestimmte Merkmale dieser Verbindung, wie z. B. die Verwendung oder Nichtverwendung von Leistungssteuerung.

Logische Verbindungen und Transporte haben verschiedene Parameter, die dazu dienen, einen bestimmten Satz von Datenkommunikationsanforderungen über eine physikalische Verbindung unter Verwendung eines bestimmten physikalischen Kanaltyps zu unterstützen.

Zum Beispiel verwendet die zuverlässige, bidirektionale Punkt-zu-Punkt-Kommunikation in Bluetooth LE den asynchronen verbindungsorientierten logischen Transport (ACL) mit entweder einer LE-C-Verbindung für Steuerdaten oder einer LE-U-Verbindung für Nutzdaten über eine physikalische Verbindung, die auf dem LE Piconet Physical Channel basiert.

Andererseits verwendet die unzuverlässige, unidirektionale Broadcast-Kommunikation in Bluetooth LE den logischen Transport LE Advertising Broadcast (ADVB) mit entweder einem ADVB-C-Link für Steuerdaten oder einem ADVB-U-Link für Nutzdaten über eine physikalische Verbindung, die auf dem LE Advertising Physical Channel basiert.

7.8 Die logischen Transporte

7.8.1 LE ACL - LE Asynchroner verbindungsorientierter logischer Transport

Wenn zwei Bluetooth LE miteinander verbunden sind, verwenden sie den asynchronen verbindungsorientierten logischen Transport (LE-ACL oder einfach ACL). LE-ACL ist einer der am häufigsten verwendeten logischen Bluetooth LE , der eine verbindungsorientierte Kommunikation von Daten ermöglicht. Tatsächlich werden ACL-Verbindungen im Allgemeinen einfach als Verbindungen bezeichnet.

Ein Gerät kann eine Verbindung mit einem werbenden Gerät herstellen, indem es auf ein empfangenes Werbepaket mit einer PDU antwortet, die eine Verbindung anfordert. In der Anfrage wird eine Reihe von Parametern angegeben. Zu diesen Parametern gehören die Zugriffsadresse, das Verbindungsintervall, die periphere Latenz, der Überwachungs-Timeout und die Kanalzuordnung.

Das Gerät, das die Verbindung anfordert, geht vom Bereitschaftszustand in den Initiierungszustand über, wechselt dann in den Verbindungszustand und übernimmt die Rolle der Zentrale. Das andere Gerät geht vom Zustand "Werbung" in den Zustand "Verbindung" über und nimmt die Rolle des Peripheriegeräts ein.

Der Parameter für das Verbindungsintervall legt fest, wie oft (in Millisekunden) das Funkgerät für die Bedienung dieser Verbindung verwendet werden kann. Wann immer das Verbindungsintervall abläuft, beginnt ein Verbindungsereignis, und zu diesem Zeitpunkt kann das zentrale Gerät in der Verbindung ein Paket senden. Verbindungsereignisse für eine bestimmte Verbindung haben jeweils eine 16-Bit-Kennung, die ein Zählerwert ist, der bei jedem Ereignis erhöht wird. Zu Beginn eines jeden Verbindungsereignisses wird der zu verwendende Funkkanal mit Hilfe des entsprechenden Kanalauswahlalgorithmus ausgewählt.

Der Parameter Überwachungs-Timeout gibt die maximale Zeit an, die zwischen dem Empfang von zwei Link-Layer-Datenpaketen verstreichen darf, bevor die Verbindung als verloren gilt.

Das Peripheriegerät, das über dieselben vereinbarten Verbindungsparameter wie das Zentralgerät verfügt, weiß, wann und über welchen Kanal es die von der Zentrale gesendeten Pakete zu erwarten hat, und kann sich daher dafür entscheiden, genau zur gleichen Zeit auf diesem Kanal zu lauschen und somit das Paket von der Zentrale zu empfangen. Nach dem Empfang des letzten Bits des Pakets der Zentrale wartet das Peripheriegerät eine kurze Zeitspanne (Standardwert 150 Mikrosekunden) und kann dann dem Zentralgerät antworten. Beachten Sie, dass die Zeitspanne zwischen den Paketübertragungen als Inter-Frame-Space-Time (IFS) bezeichnet wird.

Die Zentrale und das Peripheriegerät wechseln sich dann mit dem Senden und Empfangen von Paketen ab und können während des Verbindungsvorgangs eine durch die Implementierung festgelegte Anzahl von Paketen austauschen. Das Verhalten des Peripheriegeräts kann durch einen Parameterwert für die Latenzzeit des Peripheriegeräts, der nicht Null ist, geändert werden.

Abbildung 11 zeigt einen grundlegenden Austausch von Paketen während zweier Verbindungsereignisse, wobei C>P die Paketübertragung durch die Zentrale und P>C durch das Peripheriegerät anzeigt.

Abbildung 11 - Austausch von Basispaketen über eine LE-ACL-Verbindung

Pakete, die über eine LE ACL-Verbindung ausgetauscht werden, enthalten entweder LL-Daten-PDUs oder LL-Steuer-PDUs, die mit Link-Layer-Steuerungsverfahren verbunden sind.

7.8.1.2 Bestellung und Bestätigungen

LE-ACL beinhaltet ein System, das sicherstellt, dass die Daten in der richtigen Reihenfolge verarbeitet werden, dass der Empfang von Paketen bestätigt werden kann und dass auf dieser Grundlage entschieden wird, ob mit dem nächsten Paket fortgefahren oder stattdessen das vorherige Paket erneut übertragen wird.

Datenpakete enthalten drei wichtige Felder, die zur Zuverlässigkeit der Kommunikation beitragen. Diese Felder sind die Sequenznummer (SN), die nächste erwartete Sequenznummer (NESN) und das Feld Weitere Daten. Bei allen drei Feldern handelt es sich um Ein-Bit-Felder, deren Verwendung ein System von Bestätigungen und eine Methode zur Überprüfung der richtigen Reihenfolge der empfangenen Pakete ermöglicht.

Die Kommunikation beginnt damit, dass das zentrale Gerät (Gerät A) ein Link-Layer-Datenpaket sendet, bei dem SN und NESN beide auf Null gesetzt sind. Von diesem Zeitpunkt an wechselt der Wert des SN-Feldes, wie er von Gerät A eingestellt wurde, bei jedem stattfindenden Paketaustausch zwischen Null und Eins, wenn alles in Ordnung ist. Das Peripheriegerät (Gerät B) weiß daher immer, wie der SN-Wert des nächsten zu empfangenden Pakets sein sollte, und überprüft dies.

Wenn Gerät B ein Paket von Gerät A mit dem erwarteten SN-Wert empfängt, antwortet es mit einem Datenpaket der Verbindungsschicht, in dem NESN auf den logischen Wert NOT(SN) gesetzt ist. Wenn der empfangene SN-Wert beispielsweise 1 war, wird NESN in der Antwort 0 sein.

Wenn Gerät A eine Antwort von Gerät B erhält, in der NESN auf den Wert gesetzt ist, den Gerät A in seinem nächsten Paket für SN zu verwenden beabsichtigt, betrachtet Gerät A dies als eine Bestätigung von Gerät B, dass es das zuletzt gesendete Paket korrekt empfangen hat. Abbildung 12 zeigt dies.

Abbildung 12 - Ein erfolgreicher Austausch von Paketen auf der Verbindungsschicht

Wenn Gerät B ein Paket mit dem falschen SN-Wert empfängt, geht es davon aus, dass es sich um die erneute Übertragung des zuvor empfangenen Pakets handelt, bestätigt es, leitet es aber nicht zur weiteren Verarbeitung weiter.

Erhält Gerät A in einer Antwort von Gerät B einen unerwarteten NESN-Wert oder gar keine Antwort, sendet es das Paket erneut mit demselben SN-Wert, der ursprünglich verwendet wurde. Es steht den verschiedenen Controller-Implementierungen frei, unterschiedliche Algorithmen zu implementieren, um festzulegen, wie oft das Paket erneut gesendet werden muss, bevor die Kommunikation als gescheitert gilt. Siehe Abbildung 13.

Abbildung 13 - Wiederholte Übertragungen auf der Verbindungsschicht

Jedes Paket enthält ein CRC-Feld, und verschlüsselte Pakete enthalten auch ein MIC-Feld. Beim Empfang eines Pakets prüft die Verbindungsschicht den CRC-Wert und, falls vorhanden, den MIC-Wert. Wenn eine der beiden Prüfungen fehlschlägt, wird das Paket nicht bestätigt, was im Allgemeinen dazu führt, dass der Absender des Pakets es erneut sendet. Siehe Abbildung 14.

Abbildung 14 - Link Layer Behandlung von CRC-Fehlern

Das Peripheriegerät muss nicht bei jedem Verbindungsereignis auf Pakete vom Zentralgerät warten. Der Parameter für die Latenzzeit des Peripheriegeräts legt die Anzahl der aufeinanderfolgenden Verbindungsereignisse fest, während der das Peripheriegerät nicht lauschen muss. Dadurch kann das Peripheriegerät Strom sparen.

Abbildung 15 zeigt das Verhalten des Peripheriegeräts, wenn die Latenzzeit des Peripheriegeräts = 1 ist und es daher nur während alternativer Verbindungsereignisse lauscht. Die Zentrale kann während der Ereignisse, bei denen das Peripheriegerät nicht zuhört, senden, aber solche Pakete werden nicht empfangen und daher nicht bestätigt, wodurch das Verbindungsereignis beendet wird.

Abbildung 15 - Eine ACL-Verbindung mit Peripherie-Latenz = 1

LE-ACL verwendet ein Verfahren, das als adaptives Frequenzsprungverfahren bekannt ist. Zu Beginn eines jeden Verbindungsereignisses findet ein Frequenzsprung statt, wobei ein Funkkanal mit Hilfe eines Kanalauswahlalgorithmus deterministisch aus der Menge der verfügbaren Kanäle ausgewählt wird. Jedes Gerät in der Verbindung schaltet dann auf den ausgewählten Kanal um, und im Laufe der Zeit und einer Reihe von Verbindungsereignissen findet die Kommunikation über eine häufig wechselnde Reihe verschiedener Kanäle statt, die über das 2,4-GHz-Band verteilt sind, wodurch die Wahrscheinlichkeit von Kollisionen erheblich verringert wird.

Von den 40 Kanälen, die für die Verwendung durch Bluetooth LE definiert sind, stehen 37 dieser Kanäle (die so genannten Allzweckkanäle) für eine LE-ACL-Verbindung zur Verfügung.

In einer bestimmten Umgebung funktionieren einige Bluetooth möglicherweise nicht gut, weil sie durch Störungen beeinträchtigt werden, während andere Kanäle zuverlässig funktionieren. Im Laufe der Zeit kann sich die Liste der zuverlässigen und unzuverlässigen Kanäle ändern, wenn andere drahtlose Kommunikationsgeräte in der Umgebung kommen und gehen.

Das zentrale Gerät in einer Verbindung unterhält eine Kanalkarte, die die Mehrzweckkanäle als verwendet oder nicht verwendet klassifiziert. Diese Kanalkarte wird mit dem Peripheriegerät über ein Verbindungsschichtverfahren ausgetauscht, so dass beide über dieselben Informationen darüber verfügen, welche Kanäle verwendet werden und welche nicht. Der Kanalauswahlalgorithmus stellt sicher, dass als ungenutzt eingestufte Kanäle vermieden werden.

Standardmäßig werden alle Mehrzweckkanäle als verwendet eingestuft, aber die Zentralgeräte können implementierungsspezifische Techniken verwenden, um zu überwachen, wie gut die einzelnen Kanäle funktionieren. Stellt die Zentrale fest, dass ein oder mehrere Kanäle nicht gut genug funktionieren, kann sie deren Klassifizierung in der Kanalkarte auf unbenutzt aktualisieren. Wird hingegen festgestellt, dass ein zuvor schlecht funktionierender Kanal jetzt gut funktioniert, kann seine Klassifizierung in der Kanalkarte auf verwendet aktualisiert werden. Die Aktualisierungen der Kanalzuordnung können dann an das Peripheriegerät weitergegeben werden.

Ein Peripheriegerät kann auch seine eigene Kanalüberwachung durchführen und in regelmäßigen Abständen Kanalstatusberichte an das Zentralgerät senden, wobei der Status jedes Kanals als gut, schlecht oder unbekannt eingestuft wird. Die Zentrale kann dann Entscheidungen über die Kanalklassifizierung in der Kanalkarte treffen, die sowohl ihre eigenen Funkbedingungen als auch die des entfernten Peripheriegeräts berücksichtigen.

Auf diese Weise ist es möglich, dass ein Bluetooth LE nur die optimale Untergruppe der verfügbaren Kanäle verwendet und so zum Beispiel effektiv mit anderen drahtlosen Technologien koexistiert, die statisch zugewiesene Kanäle verwenden. Dies ist der adaptive Aspekt des adaptiven Frequenzsprungsystems von Bluetooth.

| Hinweis: Regulierungsbehörden können adaptive Frequenzsprünge und die damit verbundene Terminologie anders definieren als die Bluetooth-Kernspezifikation. Es wird empfohlen, die Vorschriften für die Frequenznutzung in den Zielmärkten bereits zu Beginn des Produktentwicklungszyklus zu prüfen, da sich daraus bestimmte Implementierungsentscheidungen ergeben können. Siehe Abschnitt 18. Zusätzliche Ressourcen finden Sie einen Link zum Regulatory Aspects Document der Bluetooth SIG, das Hinweise zu regulatorischen Fragen enthält. |

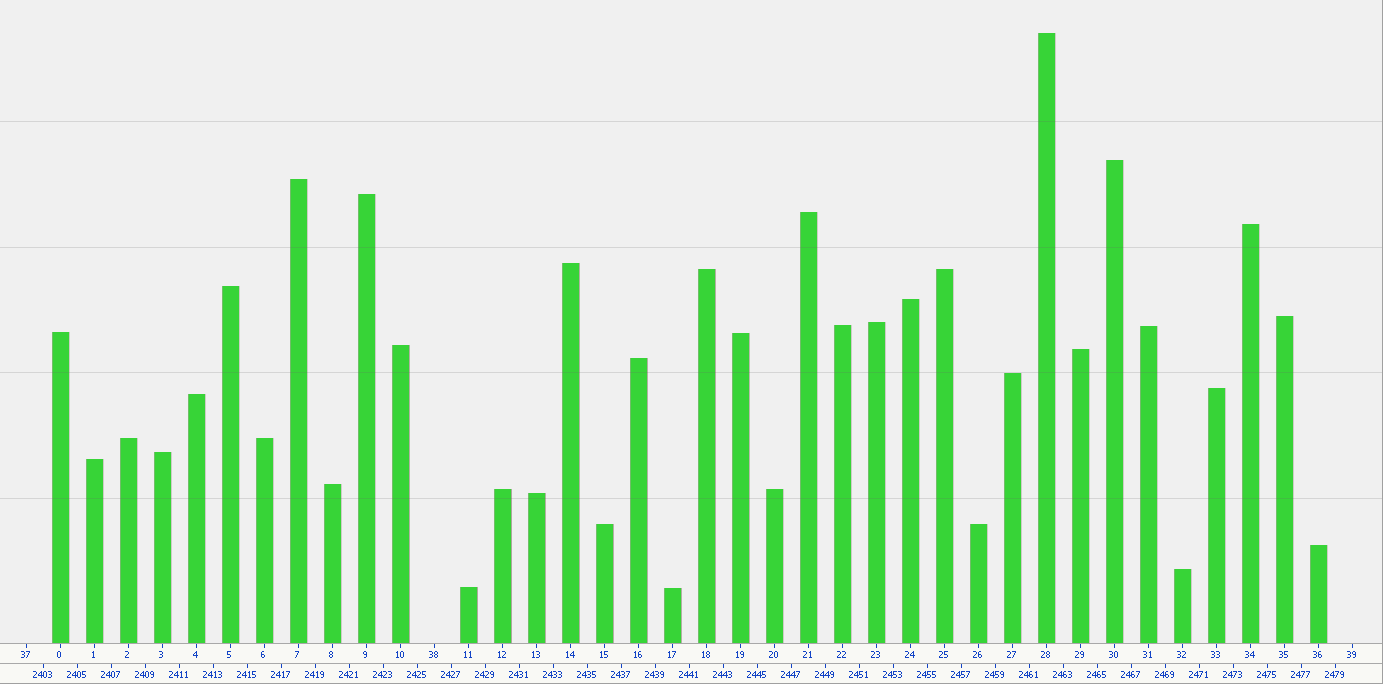

Abbildung 16 zeigt, wie die Kanäle während des Tests von zwei angeschlossenen Geräten genutzt wurden, und veranschaulicht, wie sich die Funknutzung über das ISM-2,4-GHz-Spektrum verteilt. Am unteren Rand des Diagramms sehen Sie den Kanalindex und die Frequenzen in MHz. Der Kanalindex ist eine indirekte Art, einen Funkkanal zu referenzieren.

Abbildung 16 - Adaptives Frequenzsprungverfahren zur Verteilung der Kommunikation auf verschiedene Kanäle

7.8.1.5 Kontrolle der Verbindungsschicht

Die Spezifikation der Verbindungsschicht legt eine Reihe von Kontrollverfahren fest. Eine Auswahl von Beispielen ist in Tabelle 5 aufgeführt.

| Kontrollverfahren | Beschreibung |

|---|---|

| Update der Verbindung | Ermöglicht es entweder dem zentralen oder dem peripheren Gerät, Änderungen der Verbindungsparameter Verbindungsintervall, periphere Latenzzeit und Überwachungs-Timeout anzufordern. |

| Update der Kanalkarte | Ermöglicht es dem Zentralgerät, seine neuesten Kanalzuordnungsdaten an das angeschlossene Peripheriegerät zu übertragen. |

| Verschlüsselung | Ermöglicht es, die Verschlüsselung von Paketen entweder zentral oder dezentral zu aktivieren. |

| Austausch von Funktionen | Ermöglicht es der Zentrale oder dem Peripheriegerät, einen Austausch der von jedem Gerät unterstützten Verbindungsschichtmerkmale zu initiieren, die als Bitmap-Feld kodiert sind. |

| Periodische Werbung Sync-Übertragung | Ermöglicht es entweder der Zentrale oder der Peripherie, Synchronisationsinformationen über periodische Werbung[7] zu übertragen, die sich auf einen periodischen Werbezug beziehen, der dem anderen Gerät über eine LE ACL-Verbindung entdeckt wurde. |

| CIS-Erstellungsverfahren | Ermöglicht einem zentralen Gerät, einen Connected Isochronous Stream (CIS)[8] mit dem Peripheriegerät zu erstellen. |

| Anfrage zur Leistungssteuerung | Ermöglicht es einem Peer, den anderen Peer aufzufordern, seinen Sendeleistungspegel anzupassen. |

| Berichte zur Kanalklassifizierung | Ermöglicht es einem Peripheriegerät, Daten zur Kanalklassifizierung an die angeschlossene Zentrale zu melden. |

Tabelle 5 - Beispiel für Kontrollverfahren auf der Verbindungsschicht

7.8.1.6 Unterbemessene Verbindungen

Unterbewertete Verbindungen sind LE ACL-Verbindungen, denen zusätzliche Eigenschaften zugewiesen sind und die sich in mancher Hinsicht anders verhalten. Die zusätzlichen Eigenschaften werden als Subrate-Faktor, Subrate-Basisereignis und Fortsetzungsnummer bezeichnet.

Die untergeordneten Verbindungseigenschaften bieten einen Mechanismus, mit dem angegeben werden kann, dass nur eine bestimmte Teilmenge von Verbindungsereignissen von den angeschlossenen Geräten aktiv genutzt werden soll, während das Funkgerät bei anderen Verbindungsereignissen nicht verwendet wird. Eine unterbewertete Verbindung kann daher ein kurzes ACL-Verbindungsintervall haben, aber dennoch einen niedrigen Duty Cycle aufweisen.

Abbildung 17 veranschaulicht die grundlegenden Konzepte im Zusammenhang mit unterbewerteten Verbindungen

Abbildung 17 - Eine einfache unterbewertete Verbindung mit Unterbewertungsfaktor=5

Hier können wir sehen, dass nur eines von fünf Verbindungsereignissen genutzt wird. Die anderen vier werden übersprungen, so dass während dieser Verbindungsereignisse keine Funkaktivität stattfindet. Dieses Verhältnis zwischen genutzten und übersprungenen Verbindungsereignissen wird durch den Parameter "Subrate-Faktor" bestimmt, der in diesem Beispiel auf 5 gesetzt ist.

Das Verbindungsereignis, bei dem das Funkgerät zum Senden und Empfangen von Paketen der Verbindungsschicht verwendet wird, wird als subrated connection event bezeichnet.

Angesichts der Beziehung zwischen den zugrundeliegenden ACL-Verbindungsparametern und den Parametern, die das Subrating von Verbindungen regeln, kann man sich eine Verbindung mit Subrating so vorstellen, dass sie sowohl ein Verbindungsintervall hat, das die Häufigkeit steuert, mit der ACL-Verbindungsereignisse auftreten, als auch ein effektives Verbindungsintervall, das bestimmt, wie oft diese ACL-Verbindungsereignisse tatsächlich genutzt werden, nachdem die Subrating-Parameter angewendet worden sind.

Unterbewertete Verbindungen verwenden einen anderen Satz von Link-Layer-Kontrollverfahren, und insbesondere das Verfahren zur Aktualisierung von unterbewerteten Verbindungsparametern funktioniert anders als das allgemeine Kontrollaktualisierungsverfahren. Entscheidend ist, dass Änderungen an unterbewerteten Verbindungsparametern fast augenblicklich vorgenommen werden können, während es bei allgemeinen Parameteränderungen sehr lange dauern kann, bis sie wirksam werden. Der Vorteil von subrated-Verbindungen besteht also darin, dass dauerhafte Verbindungen, die ein geringes Tastverhältnis aufweisen und wenig Strom verbrauchen, aufgebaut werden können und ohne für den Benutzer spürbare Verzögerung auf eine Verbindung mit hohem Tastverhältnis und hoher Bandbreite umgeschaltet werden können. Diese Fähigkeit ist besonders in einigen LE-Audio-Szenarien anwendbar, z. B. bei Hörgeräten und Smartphones.

Die Bluetooth Core Specification Version 5.3 Feature Enhancements enthält ein umfangreiches Kapitel zum Thema subrated connections und wird als Quelle für weitere Informationen empfohlen.

7.8.2 ADVB - LE Advertising Broadcast

LE Advertising Broadcast (oder einfach Advertising) bietet einen verbindungslosen Kommunikationsmodus. Er kann zur Datenübertragung oder zur Anzeige der Verfügbarkeit eines Peripheriegeräts verwendet werden, an das eine Verbindung hergestellt werden soll.

Im Allgemeinen sind Werbepakete dazu bestimmt, von jedem Scan-Gerät in Reichweite empfangen zu werden, und daher kann Werbung zur gleichzeitigen Übertragung von Daten an mehrere Scan-Geräte in einer One-to-many-Topologie verwendet werden. Eine besondere Form der Werbung, die als gerichtete Werbung bezeichnet wird, ist jedoch definiert und ermöglicht die verbindungslose Kommunikation von Daten von einem werbenden Gerät zu einem bestimmten Scan-Gerät, das durch seine Bluetooth-Geräteadresse identifiziert wird.

Werbung, wie sie für den logischen ADVB-Transport gilt, unterstützt die Kommunikation von Anwendungsdaten nur in einer Richtung, nämlich vom werbenden Gerät zu den scannenden Geräten, aber solche Geräte können auf Werbepakete mit PDUs antworten, die weitere Informationen oder den Aufbau einer Verbindung anfordern. Wenn ein Scanning-Gerät antwortet, um weitere Informationen zu erhalten, spricht man von einem aktiven Scanning. Wenn es dies nicht tut, spricht man von passivem Scanning.

Werbung wird im Allgemeinen als unzuverlässiger Transport bezeichnet, da von den Empfängern keine Bestätigungen gesendet werden.

Es sind zwei Kategorien von Werbeverfahren definiert, die in der Bluetooth Core Specification als Legacy Advertising und Extended Advertising bezeichnet werden.

7.8.2.2.1 Kanalnutzung und Paketgröße

Legacy-Werbepakete, die den PDU-Typ ADV_IND verwenden (siehe 7.8.2.2.3 Legacy-Werbung und zugehörige PDU-Typen), sind 37 Oktette lang, mit einem 6-Oktett-Header und einer Nutzlast von höchstens 31 Oktetten. Identische Kopien von Werbepaketen werden auf bis zu drei dedizierten Kanälen mit den Nummern 37, 38 und 39, den so genannten primären Werbekanälen, übertragen, und zwar ein Kanal nach dem anderen und in einer bestimmten Reihenfolge.

Abbildung 18 - Ältere Werbung und Kanalnutzung

7.8.2.2.2 Zeitplanung

Die Übertragung eines Werbepakets erfolgt immer dann, wenn ein Werbeereignis eintritt. Die Terminierung der Werbeereignisse wird durch Zeitparameter gesteuert und ist im Grundfall bewusst etwas unregelmäßig gestaltet, um anhaltende Kollisionen mit anderen Werbegeräten zu vermeiden. Einem als advDelay bezeichneten Wert wird bei jedem Werbeereignis ein Pseudozufallswert im Bereich von 0 bis 10 ms zugewiesen, der zum regulären Werbeintervall(advInterval) addiert wird, so dass die Werbeereignisse zeitlich gestört werden. Abbildung 19 gibt Abbildung 4.5 aus Band 6 Teil B der Bluetooth-Kernspezifikation wieder und veranschaulicht die Wirkung des Parameters advDelay.

Abbildung 19 - Zeitlich gestörte Werbeereignisse mit advDelay

Die Planung von Werbeereignissen auf diese Weise hilft, Kollisionen zu vermeiden, erschwert aber den Empfängern den effizienten Empfang von Werbepaketen, da ein höherer RX-Duty-Cycle erforderlich ist, um den unvorhersehbaren Zeitpunkt von Werbeereignissen zu berücksichtigen.

7.8.2.2.3 Veraltete Werbung und zugehörige PDU-Typen

Es sind mehrere PDU-Typen für die Verwendung mit Legacy Advertising definiert. Verschiedene PDU-Typen werden für ungerichtete Werbung verwendet, bei der die Pakete für ein beliebiges Scanning-Gerät bestimmt sind, und für gerichtete Werbung, bei der die Pakete an ein bestimmtes Gerät gerichtet sind. Der PDU-Typ gibt auch an, ob aktives Scannen erlaubt ist oder nicht, wobei die Empfänger mit Anfragen nach weiteren Daten antworten, und ob mit dem werbenden Gerät eine Verbindung hergestellt werden darf oder nicht. Die gesamte Legacy-Werbung findet auf einem oder mehreren der Primärkanäle mit den Nummern 37, 38 und 39 statt und darf nur den LE 1M PHY verwenden.

In Tabelle 6 sind die Legacy-PDUs für Werbung aufgeführt.

| PDU-Name | Beschreibung | Kanäle | PHY(s) | Übermittelt von | Einlesbar | Anschließbar |

|---|---|---|---|---|---|---|

| ADV_IND | Ungezielte Werbung | primär | LE 1M | Peripherie | Y | Y |

| ADV_DIRECT_IND | Gezielte Werbung | primär | LE 1M | Peripherie | N | Y |

| ADV_NONCONN_IND | Ungezielte, nicht verknüpfbare, nicht durchsuchbare Werbung | primär | LE 1M | Peripherie | N | N |

| ADV_SCAN_IND | Ungezielte, durchsuchbare Werbung | primär | LE 1M | Peripherie | Y | N |

| SCAN_REQ | Anfrage scannen | primär | LE 1M | Zentrale | K.A. | K.A. |

| SCAN_RSP | Scan-Antwort | primär | LE 1M | Peripherie | K.A. | K.A. |

| CONNECT_IND | Anfrage verbinden | primär | LE 1M | Zentrale | K.A. | K.A. |

Tabelle 6 - Ältere Werbe-PDUs

Abschnitt 4.4 des Kapitels über die Spezifikation der Verbindungsschicht in der Bluetooth enthält vollständige Angaben zu allen Werbe-PDU-Typen.

Mit der Version 5 der Bluetooth Core Specification wurden einige wichtige Änderungen an der Art und Weise vorgenommen, wie Werbung durchgeführt werden kann. Es wurden acht neue PDUs für Werbung, Scannen und Verbindung hinzugefügt und neue Verfahren definiert. Dieser neue Satz von Werbemöglichkeiten wird als " erweiterte Werbung" bezeichnet.

Die erweiterte Werbung ermöglicht die Übertragung sehr viel größerer Datenmengen, die Durchführung von Werbung nach einem deterministischen Zeitplan und die Übertragung mehrerer verschiedener Sätze von Werbedaten, die unterschiedlichen Konfigurationen unterliegen. Sie bietet auch erhebliche Verbesserungen in Bezug auf die Konkurrenzsituation und den Arbeitszyklus.

Die erweiterte Werbung wird sowohl von den logischen Transporten ADVB als auch PADVB verwendet.

7.8.2.3.1 Kanalnutzung und Paketgröße

Die Funkkanäle werden anders genutzt als bei der herkömmlichen Werbung, wobei die Hauptwerbekanäle 37, 38 und 39 weniger Daten übertragen und die Mehrzweckkanäle 0 - 36 den größten Teil der Daten übertragen.

Wie in 7.8.2.2 Legacy-Werbung beschrieben, überträgt Legacy-Werbung dieselbe Nutzlast bis zu dreimal auf drei verschiedenen primären Werbekanälen. Bei der erweiterten Werbung werden die Nutzdaten nur einmal übertragen, und zwar mit kleinen Headern, die auf die Nutzdaten in den primären Kanälen verweisen. Die Gesamtmenge der übertragenen Daten ist daher geringer als im entsprechenden Fall mit Legacy-Werbung, so dass der effektive Duty Cycle reduziert wird.

Abbildung 20 - Geringere Konkurrenzsituation und geringere Einschaltdauer

Bei der erweiterten Werbung können die Pakete bis zu 255 Oktette lang sein. Dies wird zum Teil dadurch erreicht, dass die Nutzlast auf einen der Allzweckkanäle im Kanalnummernbereich 0-36 verlagert wird.

Abbildung 21 - Erweiterte Werbung unterstützt größere Werbepakete und Channel Offload

Bei erweiterter Werbung werden auf den primären Kanälen mit den Nummern 37, 38 und 39 nur Kopfdaten übertragen. Dazu gehört ein Feld namens AuxPtr.

Das Feld AuxPtr verweist auf ein zugehöriges Hilfspaket, das die Nutzlast enthält, die auf einem Allzweckkanal aus der Gruppe der Kanäle mit den Nummern 0 - 36 übertragen wird. AuxPtr enthält den Index des Allzweckkanals, der den Kanal angibt, auf dem das Hilfspaket übertragen wird, damit die Empfänger wissen, wo es zu finden ist. Pakete, die auf einem Allzweckkanal übertragen werden und durch das Feld AuxPtr von einem Paket auf den Primärkanälen referenziert werden, werden als untergeordnete Pakete bezeichnet, während das referenzierende Paket als übergeordnetes Paket bezeichnet wird.

Die Auswahl der Kanalindexwerte in AuxPtr ist implementierungsspezifisch, wobei die Bluetooth nur empfiehlt, dass "eine ausreichende Kanaldiversität verwendet wird, um Kollisionen zu vermeiden".

7.8.2.3.2 Paketverkettung

Für Anwendungsfälle, in denen eine Anwendung noch mehr Daten (bis zu 1.650 Byte) übertragen muss, kann der Controller die Daten fragmentieren und Pakete aneinanderreihen, wobei jedes Paket eine Teilmenge dieser Daten enthält. Jedes verkettete Paket kann auf einem anderen Kanal übertragen werden, wobei das AuxPtr-Header-Feld auf das nächste in der Kette verweist. Abbildung 22 veranschaulicht dies.

Abbildung 22 - Erweiterte Werbung mit Paketverkettung

7.8.2.3.3 Werbesets

Die bisherige Werbung sieht keine formale Möglichkeit vor, die Nutzdaten und Parameter der Werbung zu variieren. Die erweiterte Werbung enthält einen Standardmechanismus für mehrere, unterschiedliche Sätze von Werbedaten.

Die Werbesätze haben eine ID, die angibt, zu welchem Satz ein bestimmtes Paket gehört, und jeder Satz hat seine eigenen Werbeparameter, z. B. das Werbeintervall und den zu verwendenden PDU-Typ.

Die Aufgabe, die verschiedenen Gruppen zu planen und zu übertragen, fällt dem Link Layer im Controller zu und muss nicht vom Host gesteuert werden, was weit weniger energieeffizient wäre. Der Host muss dem Controller nur anfangs die Werbesätze und ihre jeweiligen Parameter mitteilen, danach übernimmt der Link Layer die Aufgabe.

7.8.2.3.4 Regelmäßige Werbung

Die erweiterte Werbung umfasst eine Werbemethode, bei der eine deterministische Zeitplanung verwendet wird, deren Einzelheiten von Scannern entdeckt und synchronisiert werden können. Dies wird als Periodic Advertising bezeichnet. Periodische Werbung ist als eigener logischer Transport definiert und wird daher in Abschnitt 7.8.3 PADVB - LE Periodic Advertising Broadcast beschrieben.

7.8.2.3.5 Erweiterte Werbung und zugehörige PDU-Typen

Eine Reihe von PDU-Typen sind für die Verwendung mit erweiterter Werbung definiert. In Tabelle 7 sind die PDUs für die erweiterte Werbung aufgeführt.